MCP Apps × Vonage で、多言語カスタマーサポートをサポートする MCPサーバーを作ってみた

公開日:2026/03/04

技術ノウハウ・Tips勉強会・社内ナレッジ共有

はじめに

先日、弊社主催のエンジニア交流会の中で、株式会社KDDIウェブコミュニケーションズ さま(以下、KWC さま)にオフラインハンズオン会を開催していただきました。

エンジニア交流会については、弊社ニュース記事をご覧ください。

第1回エンジニア交流会を開催しました ― Vonageハンズオン×エンジニア同士の対話で広がる学びの場

Vonage という CPaaS の Voice API と OpenAI の Realtime API を組み合わせて「チャッピー電話」(AI ボイスアシスタント)を作るという内容で、電話番号の取得から WebSocket 音声ストリーミングまで、CPaaS の世界を実際に手を動かして体験できました。KWC さま、素晴らしいハンズオン会をありがとうございました。

詳細につきましては、ハンズオン会を主導していただいた「□い(しかくい)芸人」こと高橋さまの記事をご覧ください。

ハンズオン会で「Vonage、数行のコードで SMS も電話もできて面白いな」と感じました。 それとは別に、私は MCP Apps にも注目していました。MCP Apps は、AI チャット画面の中にインタラクティブな UI を埋め込める仕組みです。

この 2つを組み合わせて何か作ってみようと考え、思い至ったのが多言語カスタマーサポートをサポートする MCPサーバーです。

完成物

まずは動くものをお見せします。

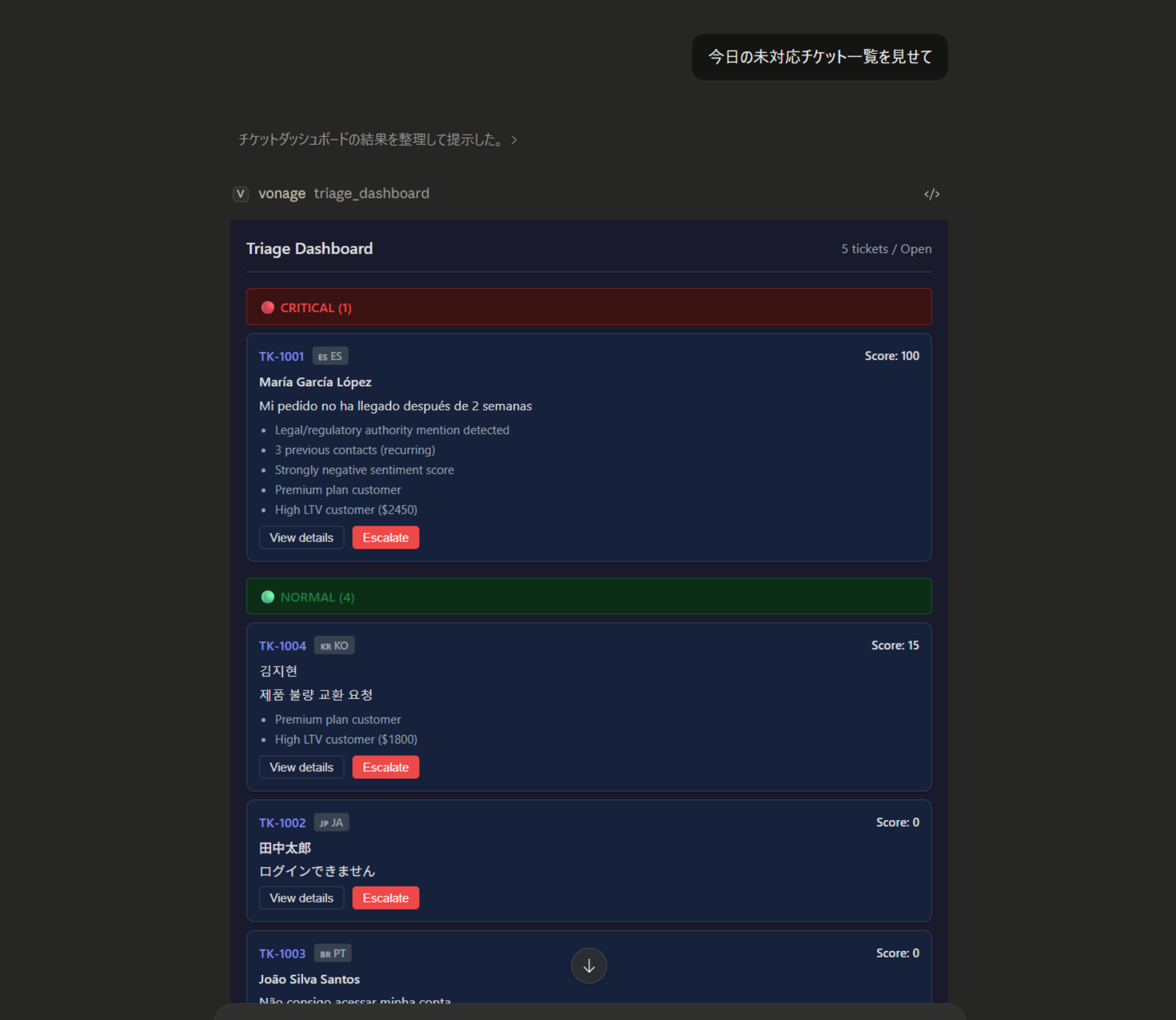

自然言語の指示だけでチケットのトリアージ → 詳細確認 → 多言語返信ドラフト生成 → SMS送信 → マネージャーへのエスカレーション通話まで、一連のカスタマーサポート業務を完結させるデモ。UIはすべて MCP Apps のサンドボックス iframe内にインタラクティブに表示されています。

主な機能

| ツール | できること |

|---|---|

|

triage_dashboard

|

多言語チケットを緊急度スコアで自動分類し、ダッシュボード表示 |

|

view_ticket

|

スペイン語・ポルトガル語・韓国語のチケットを OpenAI で日本語翻訳 |

|

draft_reply

|

顧客の言語で返信ドラフトを AI 生成し、バックトランスレーションで内容確認 |

|

send_customer_notify

|

Vonage SMS / WhatsApp で顧客にワンクリック通知 |

|

escalate_call

|

Vonage Voice API でマネージャーへ自動架電(TTS) |

|

analytics_overview

|

言語別・チャネル別・優先度別の統計ダッシュボード |